Mistral CEO称DeepSeek-V3基于其AI架构打造,双方论文发布时间仅差3天

来源: 时间:2026年01月26日 17:24

【岁月史书启动!Mistral CEO称DeepSeek-V3基于其AI架构打造】

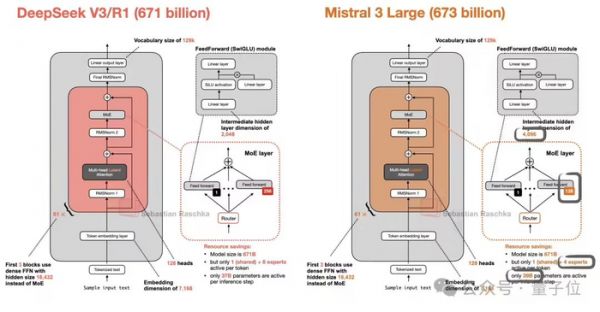

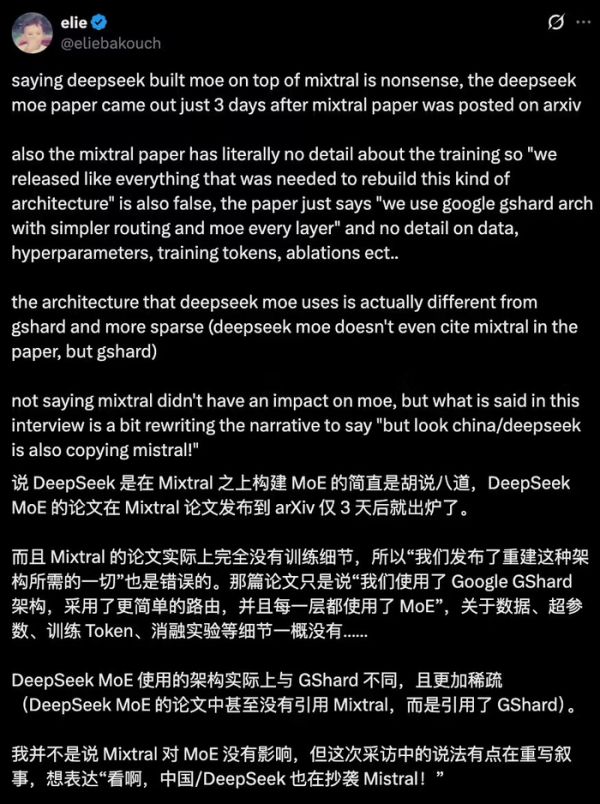

据量子位,在最近一次访谈中,当被问到如何看待中国开源AI的强势发展时,Mistral联合创始人、CEO表示:中国在AI领域实力强劲。我们是最早发布开源模型的公司之一,而他们发现这是一个很好的策略。开源不是真正的竞争,大家在彼此的基础上不断进步。比如我们在2024年初发布了首个稀疏混合专家模型(MoE),DeepSeek-V3以及之后的版本都是在此基础上构建的。它们采用的是相同的架构,而我们把重建这种架构所需的一切都公开了。

然而事实上,DeepSeek MoE论文的发布时间和Mixtral论文相差仅3天,而且两种架构的思路也不同,甚至Mistral 3 Large还曾被扒出基本上照搬了DeepSeek-V3的架构。

发布于:浙江

相关推荐

DeepSeek-V3横空出世,浙江私募力量震惊硅谷

Mistral的首个强推理模型:拥抱开源,推理速度快10倍

留给谷歌CEO的时间不多了

苹果讨论收购欧洲AI巨头Mistral或Perplexity

谷歌发布开源AI大模型Gemma 称其性能在同等规模中最为先进

法国的OpenAI,美国制造

微软麻将 AI 论文发布,首次公开技术细节

产品还没有,这家AI公司成立仅四周,种子轮获投创纪录的 1.13 亿美元

成立仅半年的AI公司,怎么成了OpenAI最大劲敌?

重磅!中国团队发布SRDA新计算架构,从根源解决AI算力成本问题,DeepSeek“神预言”成真?

网址: Mistral CEO称DeepSeek-V3基于其AI架构打造,双方论文发布时间仅差3天 http://www.xishuta.cn/newsview146478.html

推荐科技快讯

- 1问界商标转让释放信号:赛力斯 95792

- 2报告:抖音海外版下载量突破1 25736

- 3人类唯一的出路:变成人工智能 25175

- 4人类唯一的出路: 变成人工智 24611

- 5移动办公如何高效?谷歌研究了 24309

- 6华为 nova14深度评测: 13155

- 7滴滴出行被投诉价格操纵,网约 11888

- 82023年起,银行存取款迎来 10774

- 9五一来了,大数据杀熟又想来, 9794

- 10手机中存在一个监听开关,你关 9519

科技快讯热点排名

科技快讯热点